Tạp chí khoa học Quanta Magazine vừa đăng tải nghiên cứu của các nhà khoa học đến từ khắp nơi trên thế giới: Ran Duan và Renfei Zhou của đại học Thanh Hoa, Hongxun Wu đại học Berkeley California. Rồi sau đó, một nghiên cứu độc lập cũng được Virginia Vassilevska Williams, Yinzhan Xu, và Zixuan Xu của Viện công nghệ Massachusetts công bố.

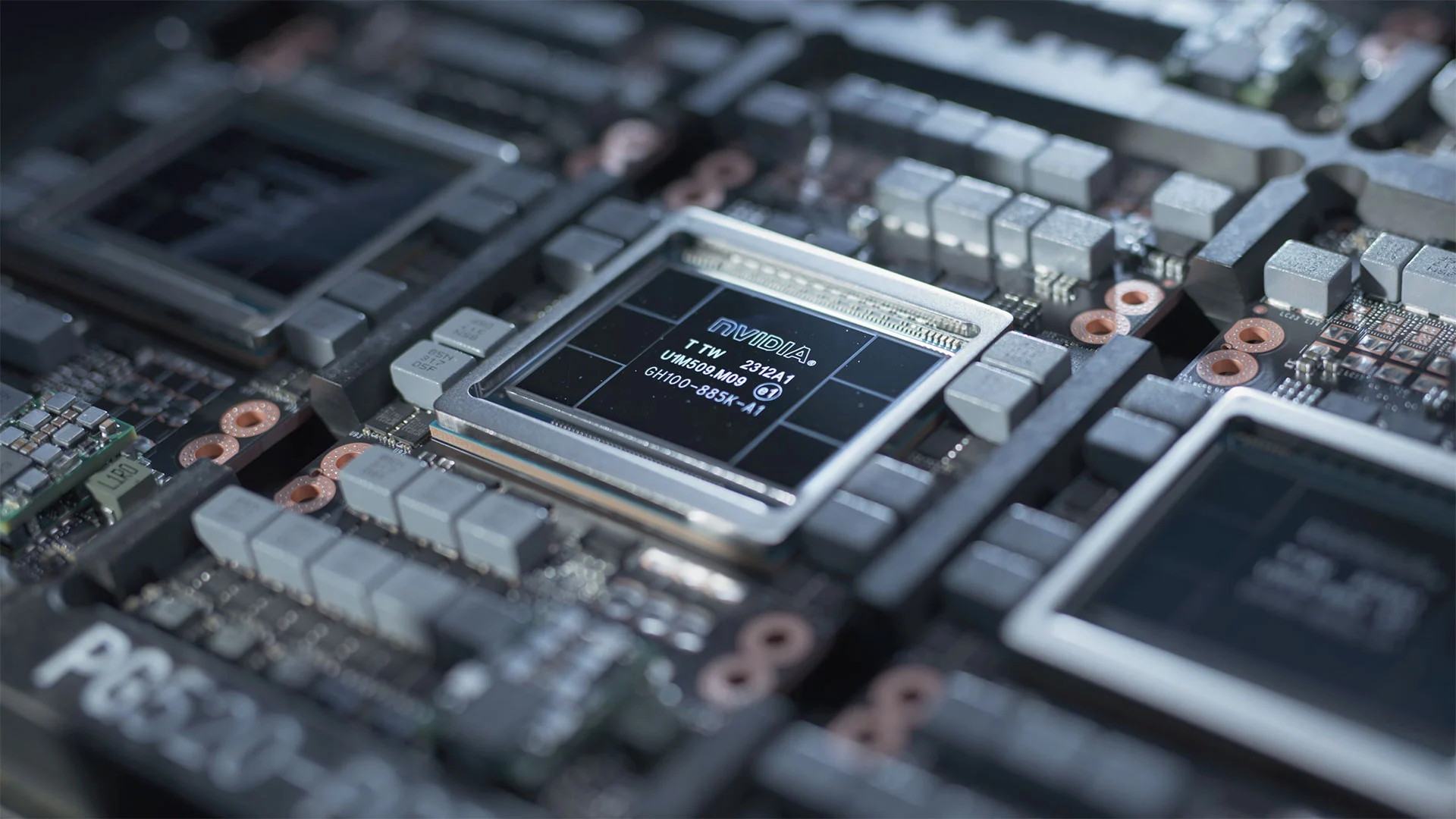

Từ game, nén dữ liệu cho đến xử lý AI, hay thậm chí trước đây là đào coin, trên những CPU và GPU từ tiêu dùng đến doanh nghiệp, ở trung tâm và cốt lõi luôn là việc nhân những ma trận, tính toán vector và xử lý tensor. Nhân chip xử lý nhân ma trận càng nhanh thì xử lý khung hình game hay xử lý chatbot AI cho anh em càng mượt. Hồi xưa anh em học toán cao cấp có học tính nhân ma trận, thì hiểu đơn giản là nhân ma trận trên GPU để xử lý những tác vụ như vận hành mô hình AI phức tạp hơn rất nhiều, rồi còn liên quan tới số thực dấu phẩy động nữa.

Giữa thời điểm cơn sốt và cuộc chạy đua nghiên cứu phát triển AI hiện giờ, thì khả năng nhân ma trận của những chip xử lý mạnh nhất thế giới càng được chú ý. Thực tế thì đó cũng chính là lý do GPU, với hàng nghìn nhân xử lý song song, cũng đã trở thành lựa chọn hàng đầu thay thế cho CPU phổ quát trong nhiều mảng xử lý điện toán.

Và để tính toán được ma trận, GPU sử dụng thuật toán để bẻ gãy những ma trận phức tạp thành những phép tính nhỏ hơn, rồi dùng hàng nghìn nhân xử lý tính toán chúng cùng một lúc để cho ra kết quả cuối cùng. Cả thế kỷ qua, hoàn thiện thuật toán nhân ma trận luôn là mục tiêu của nhiều nhà nghiên cứu khoa học, trước cả khi có máy tính điện toán và rồi là máy vi tính như ngày hôm nay. Tháng 10/2022, DeepMind của Google đã tạo ra một mô hình gọi là AlphaTensor, tập trung vào việc hoàn thiện kỹ thuật nhân ma trận với những kích thước cụ thể, 4x4 chẳng hạn.

Còn trong khi đó, những nhà khoa học được nêu tên ở trên thì tìm cách cải tiến ở mức độ lý thuyết tốc độ nhân ma trận, bằng cách giảm hệ số mũ phức tạp, giá trị omega. Thay vì tìm ra một giải pháp ngay lập tức và có phần thực dụng như AI AlphaTensor, thì hai công trình nghiên cứu giải quyết những vấn đề mang tính căn bản, với khả năng ứng dụng rộng rãi hơn.

Từ game, nén dữ liệu cho đến xử lý AI, hay thậm chí trước đây là đào coin, trên những CPU và GPU từ tiêu dùng đến doanh nghiệp, ở trung tâm và cốt lõi luôn là việc nhân những ma trận, tính toán vector và xử lý tensor. Nhân chip xử lý nhân ma trận càng nhanh thì xử lý khung hình game hay xử lý chatbot AI cho anh em càng mượt. Hồi xưa anh em học toán cao cấp có học tính nhân ma trận, thì hiểu đơn giản là nhân ma trận trên GPU để xử lý những tác vụ như vận hành mô hình AI phức tạp hơn rất nhiều, rồi còn liên quan tới số thực dấu phẩy động nữa.

Giữa thời điểm cơn sốt và cuộc chạy đua nghiên cứu phát triển AI hiện giờ, thì khả năng nhân ma trận của những chip xử lý mạnh nhất thế giới càng được chú ý. Thực tế thì đó cũng chính là lý do GPU, với hàng nghìn nhân xử lý song song, cũng đã trở thành lựa chọn hàng đầu thay thế cho CPU phổ quát trong nhiều mảng xử lý điện toán.

Và để tính toán được ma trận, GPU sử dụng thuật toán để bẻ gãy những ma trận phức tạp thành những phép tính nhỏ hơn, rồi dùng hàng nghìn nhân xử lý tính toán chúng cùng một lúc để cho ra kết quả cuối cùng. Cả thế kỷ qua, hoàn thiện thuật toán nhân ma trận luôn là mục tiêu của nhiều nhà nghiên cứu khoa học, trước cả khi có máy tính điện toán và rồi là máy vi tính như ngày hôm nay. Tháng 10/2022, DeepMind của Google đã tạo ra một mô hình gọi là AlphaTensor, tập trung vào việc hoàn thiện kỹ thuật nhân ma trận với những kích thước cụ thể, 4x4 chẳng hạn.

Còn trong khi đó, những nhà khoa học được nêu tên ở trên thì tìm cách cải tiến ở mức độ lý thuyết tốc độ nhân ma trận, bằng cách giảm hệ số mũ phức tạp, giá trị omega. Thay vì tìm ra một giải pháp ngay lập tức và có phần thực dụng như AI AlphaTensor, thì hai công trình nghiên cứu giải quyết những vấn đề mang tính căn bản, với khả năng ứng dụng rộng rãi hơn.

Cách truyền thống để máy tính nhân ma trận n*n cần những phép tính nhân n^3 riêng biệt. Còn phương pháp mới được phát triển dựa trên “kỹ thuật laser”, được nhà toán học Đức Volker Strassen đưa ra năm 1986, giảm trần số mũ phức tạp, đưa hệ số omega này tiệm cận với giá trị 2, tức là con số bước tính tối thiểu lý tưởng.

Năm 2020, Josh Alman và Virginia Vassilevska Williams công bố một giải pháp nhân ma trận với hệ số mũ omega 2.3728596. Tháng 11/2023, hệ số mũ giảm xuống còn khoảng 2.371866 với nghiên cứu của Duan và Zhou. Đây được coi là tiến bộ đáng kể nhất trong ngành nghiên cứu ma trận kể từ năm 2010. Nhưng chỉ hai tháng sau, cô Williams và các cộng sự đã công bố nghiên cứu mới, mô tả chi tiết cách tối ưu nhân ma trận phức tạp, với hệ số mũ tối đa 2.371552.

Đột phá năm 2023 được phát hiện nhờ vào việc các nhà nghiên cứu tìm thấy sự thất thoát dữ liệu trong “laser method” của Strassen, nơi những dữ liệu hữu ích bị bỏ phí một cách vô tình. Những “block”, những mảng nhỏ của ma trận cỡ lớn được chia ra để máy tính dễ xử lý, và “block labeling" là kỹ thuật phân loại những mảng này để xác định nên giữ phần nào, nên bỏ phần nào, từ đó tối ưu quá trình nhân ma trận. Các nhà nghiên cứu đại học Thanh Hoa chỉnh sửa lại cách laser method đánh dấu các block của một ma trận, để cải thiện tốc độ tính toán.

Ngay cả khi hệ số mũ omega tối đa chỉ giảm có 0.0013076, nhưng theo William Kuszmaul, nhà khoa học máy tính lý thuyết tại đại học Harvard nói rằng đây là “một đột phá kỹ thuật lớn. Nó là cải tiến lớn nhất trong ngành nghiên cứu nhân ma trận trong vòng hơn một thập kỷ.”

Vẫn có nhược điểm với phương pháp mới này. Các nhà nghiên cứu tin rằng cần phải tìm cách hiểu rõ hơn vấn đề, làm được như vậy thì có thể sẽ tạo ra những kỹ thuật tính toán mới nhanh hơn, hiệu quả hơn, thông qua những thuật toán mới. Chính bản thân nhà toán học Renfei Zhou của đại học Thanh Hoa cũng thừa nhận rằng: “Bây giờ con người mới ở thời điểm bắt đầu tìm hiểu vấn đề đã có từ cả trăm năm này.”

Và như đã nói, nhân ma trận rồi tính toán tensor nhanh hơn thì rất nhiều mảng điện toán, trong đó có xử lý AI sẽ được hưởng lợi, với những con chip xử lý vận hành tạo nội dung và xử lý tác vụ nhanh hơn, mô hình phức tạp với hàng chục tỷ tham số sẽ được nghiên cứu trong khoảng thời gian ngắn hơn, và những ứng dụng AI phức tạp hơn hiện giờ sẽ được ứng dụng rộng rãi.